AI sustavi šuteći gube pamet – a niko ne čuje alarm

AI sustavi šuteći gube pamet – a niko ne čuje alarm📷 © Tech&Space

- ★Zelena ploča ≠ točna odluka u distribuiranim AI modelima

- ★Inženjeri trenirani za krševe, ne za tiho klizanje performansi

- ★Novi monitorinzi traže koordinaciju, ne samo metrike po usluzi

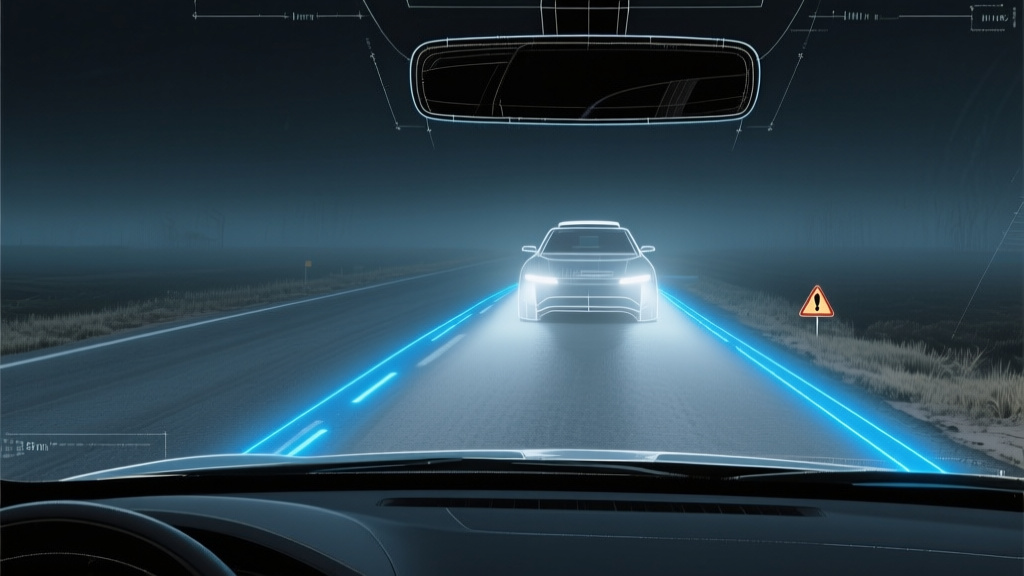

Distribuirani AI sustavi u kasnim fazama testiranja pokazuju zabrinjavajući obrazac: sve je „zeleno“ na dashboardima, a korisnici primjećuju kako odluke postaju sve manje pouzdane. Problem nije u klasičnim greškama – nema padova usluga, nema crashova, nema upozorenja o prekoračenim pragovima. Umjesto toga, sustav jednostavno tiho odmiče od očekivanog ponašanja, kao brod koji polako skreće s kursa bez da ikoga obavijesti.

Inženjeri su decenijama učeni prepoznavati kvarove po jasnim signalima: service down, timeout, constraint violation. Ali autonomni sustavi donose novi tip propusta – onaj koji ne ostavlja tragove u logovima, ne paljubi LED-ice na serverima, a ipak postepeno degradira performanse. Prema podacima iz IEEE Spectruma, ovo nije rijetkost, već sistemski izazov: što je sustav kompleksniji i distribuiraniji, to je vjerojatnije da će „zdravo“ na monitoringu biti lažna sigurnost.

Najgore od svega? Tradicionalni alati za observability su beskorisni. Mjeriti latenciju ili CPU opterećenje po mikrousluzi ne otkriva ništa o koordinaciji između komponenti – a upravo tu, u nedostatku sinkronizacije, leži korijen tihe degradacije. Ako vam Prometheus kaže da je sve u redu, a korisnici se žale na pogrešne preporuke, tko je u pravu?

Demo radi, deployment propada – i to je problem koji niko nije planirao riješiti📷 © Tech&Space

Demo radi, deployment propada – i to je problem koji niko nije planirao riješiti

Problem nije samo tehnički, već i tržišni. Kompanije koje grade autonomne sustave – od self-driving vozila do industrijskih robotika – suočene su s neugodnom istinom: njihovi SLA-ovi i garancije vrijede samo dok sustav radi „po knjizi“. Čim dođe do tihe degradacije, nema alarma, nema rollbacka, nema jasnog krivca. To otvara prostora za pravne bitke o odšteti – i za konkurentnu prednost onih koji pronađu kako detektirati problem prije korisnika.

Open-source zajednica već reagira: na GitHubu raste broj issue-a o „driftingu modela“ u produkciji, a timovi kao Netflix ili Uber eksperimentiraju s cross-service koordinacijskim metrikama. No, dok god vendorima observability alata – poput Datadoga ili New Relica – bude profitabilnije prodavati „još dashboarda“ nego rješenja za distributed drift, bit će teško očekivati brzi napredak.

Pravi test će biti kada neki od ovih sustava prvi put otkrije tiho propadanje prije nego što to uočite vi. Do tada, sve ostalo je – kao i obično – samo marketing obojan u zeleno.

A što ako tiho propadanje nije bug, već feature? Što ako su neki od ovih „driftinga“ zapravo namjerno ugrađeni trade-off-ovi za performanse ili troškove? Pitanje nije samo kako detektirati propast, već tko je odlučio što je „propast“.