GLM-5.1 ne samo da kôdira — preispituje vlastite greške 600 puta

GLM-5.1 ne samo da kôdira — preispituje vlastite greške 600 puta📷 © Tech&Space

- ★MIT licenca omogućuje slobodnu upotrebu bez restrikcija

- ★SWE-Bench Pro: nadmašuje GPT-5.4 i Claude Opus 4.6

- ★Iterativno samopoboljšanje — ili samo pametnija petlja?

Zhipu AI je objavio GLM-5.1 pod MIT licencom, što znači da ga možete uzeti, modificirati i koristiti u produkciji bez pravnih zamki. To je rijetkost u svijetu zatvorenih modela kao što su GPT-5.4 ili Claude Opus 4.6 — ali licenca nije glavna priča ovdje.

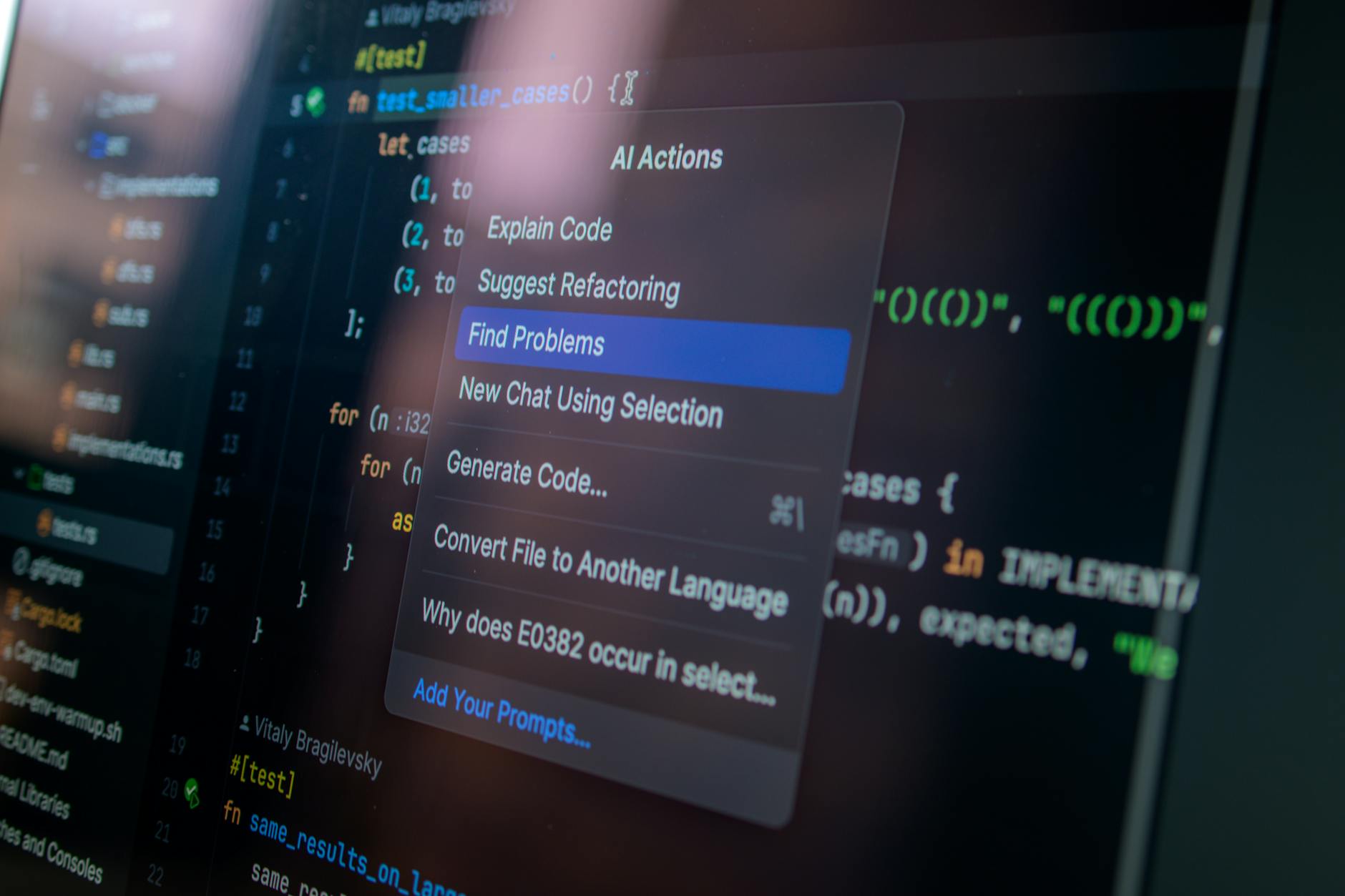

Glavna je priča sposobnost modela da, uz dovoljno resursa, ponavlja isti kodnierski zadatak do 600 puta, svaki put analizirajući vlastite greške i pokušavajući novi pristup. Ovo nije obična 'pokušaj ponovo' funkcija.

Prema istraživanju koje navode, GLM-5.1 stvarno razumije zašto je prethodni pokušaj propao — barem u kontroliranim uvjetima benchmarka. Na SWE-Bench Pro testovima, gdje modeli rješavaju realne GitHub issueove, GLM-5.1 je postigao rezultate bolje od konkurencije.

Međutim, tu počinje problem: SWE-Bench je sintetički test, a stvarni programeri ne rade u petlji od 600 iteracija s neograničenim API pozivima. Developer community na GitHubu već primjećuje da 'samokorekcija' često podsjeća na lukavo pakiranu brute-force strategiju.

Jedan korisnik je testirao model na stvarnom legacy kodu: 'Nakon 47 iteracija, dobio sam 12 različitih rješenja za isti bug — nijedno nije radilo u produkciji.' To nije kritika modela, već podsjetnik da benchmark pobjede i stvarna korisnost često idu različitim putovima.

MIT licenca i samokorekcija: koliko je GLM-5.1 stvarno napredan u odnosu na konkurenciju?📷 © Tech&Space

MIT licenca i samokorekcija: koliko je GLM-5.1 stvarno napredan u odnosu na konkurenciju?

Kratkoročno, kineski cloud provajderi kao što je Alibaba Cloud imaju najviše koristi od ovog modela. Oni već integriraju GLM modele u svoje usluge, a MIT licenca omogućuje im ponudu 'samopopravljajućeg' AI toolchaina bez plaćanja royaltija Zapadu.

Za zapadne igrače, ovo je signal da kineska AI scena ne kopira — već optimizira za specifične use caseove, poput automatizacije devops zadataka gdje je tolerancija za greške veća. No postoji i drugi kut: što ako je ovo samo packaging postojeće tehnike? ReAct paradigma koju koristi GLM-5.1 nije nova — Google ju je demonstrirao prije godinu dana.

Razlika je u tome što Zhipu tvrdi da su je skalirali na stotine iteracija bez eksponencijalnog rasta troškova. Ako je to točno, onda je stvarno napredak.

Ako nije, onda imamo još jedan 'AI koji misli' narativ koji će se srušiti čim netko provjeri inferencijske troškove u stvarnom svijetu. Pravi test će biti kada netko pokrene GLM-5.1 na zatvorenom enterprise kodu s ograničenim API kvotama.

Do tada, sve su ovo brojke na papiru — ili, bolje rečeno, na leaderboardu koji mjeri sve osim stvarne korisnosti.

Budućnost AI alata kao što je GLM-5.1 ovisit će o tome koliko će se njihove performanse mjeriti izvan sintetičkih okruženja. Dok god su benchmarkovi glavni kriterij, pravi potencijal ovih modela ostaje nepoznanica.