Microsoft skriva Copilot iza 'zabave': tko plaća cijenu?

Microsoft skriva Copilot iza 'zabave': tko plaća cijenu?📷 © Tech&Space

- ★Uvjeti zabranjuju ozbiljnu upotrebu

- ★Marketing prodaje Copilot kao poslovni alat

- ★Amazonovi AI incidenti upozoravaju na rizike

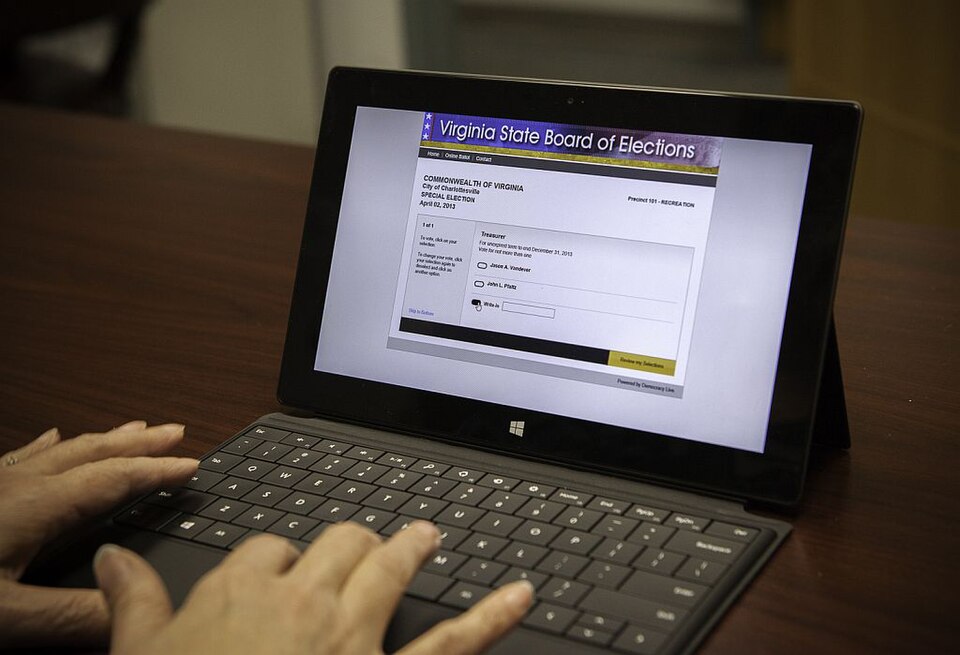

Microsoftova najava Copilota za Windows 11 i poslovne aplikacije stoji nasuprot jasnoj rečenici u uvjetima korištenja: Copilot je za zabavu i ne smije se koristiti za važne savjete. Izdanje iz listopada 2023. eksplicitno ograničava odgovornost tvrtke, dok marketinški materijali ističu integraciju u Office, GitHub i Azure kao 'produktivni pomagač'.

Razlika je više od pravne fineze. Amazonovi AWS incidenti iz 2023. pokazali su što se događa kada se AI alati koriste bez nadzora – 'Gen-AI assisted changes' doveli su do prekida rada usluga s 'high blast radius'.

Sličan scenarij mogao bi pogoditi tvrtke koje se oslanjaju na Copilot za kodiranje, automatizaciju ili analizu dokumenata, a pravna zaštita Microsofta jasno kaže: koristite na vlastitu odgovornost. Termini su gotovo identični onima koje koristi xAI ili Googleov Gemini – svi ističu 'probabilističku prirodu' AI-ja, ali samo Microsoft tako izravno zabranjuje ozbiljnu upotrebu.

Disclaimer je zabava, račun stiže poslovnim korisnicima📷 © Tech&Space

Disclaimer je zabava, račun stiže poslovnim korisnicima

Izvorni članak Tom’s Hardwarea naglašava da se radi o strategiji 'zaklonjenja iza disclaimeri' – common practice u tech industriji, ali rijetko tako izravno. Dok Google ili Meta koriste oprezan jezik, Microsoftov pristup zvuči kao da kupcima otvoreno govori: 'možete ga koristiti za posao, ali ako se nešto pokvari, mi nismo krivi'.

Igrači na GitHubu već mjesecima prijavljuju slučajeve gdje Copilot generira netočan kod ili sugerira zastarjele biblioteke, ali Microsoftov odgovor ostaje formalan: uvjeti su jasni. Za tvrtke koje ulažu milijarde u AI integraciju, pravna sigurnost postaje važnija od same tehnologije – što objašnjava zašto Microsoft i dalje promovira Copilot kao 'nezamjenjiv alat' dok istovremeno odbija odgovornost za greške.

Konačno, Microsoftov pristup prema Copilotu pokazuje koliko je važna pravna sigurnost u svijetu AI tehnologija. Dok tvrtke ulažu milijarde u AI integraciju, one moraju biti svjesne rizika koji su uključeni i uzeti potrebne korake za zaštitu sebe. To uključuje čitanje uvjeta korištenja i razumijevanje ograničenja odgovornosti tvrtke, kao i razvijanje strategija za upotrebu AI alata na odgovoran način.